Google Cloud Next ‘23 というGoogleのカンファレンスがアメリカ・サンフランシスコで開催され、グーグル・クラウド・ジャパン合同会社様からのご好意で株式会社ビズリーチから複数名のメンバーを招待いただき出席しました。以下、このカンファレンスの内容について概要を紹介します。

Cloud Nextに至るまでの生成AIの事情について

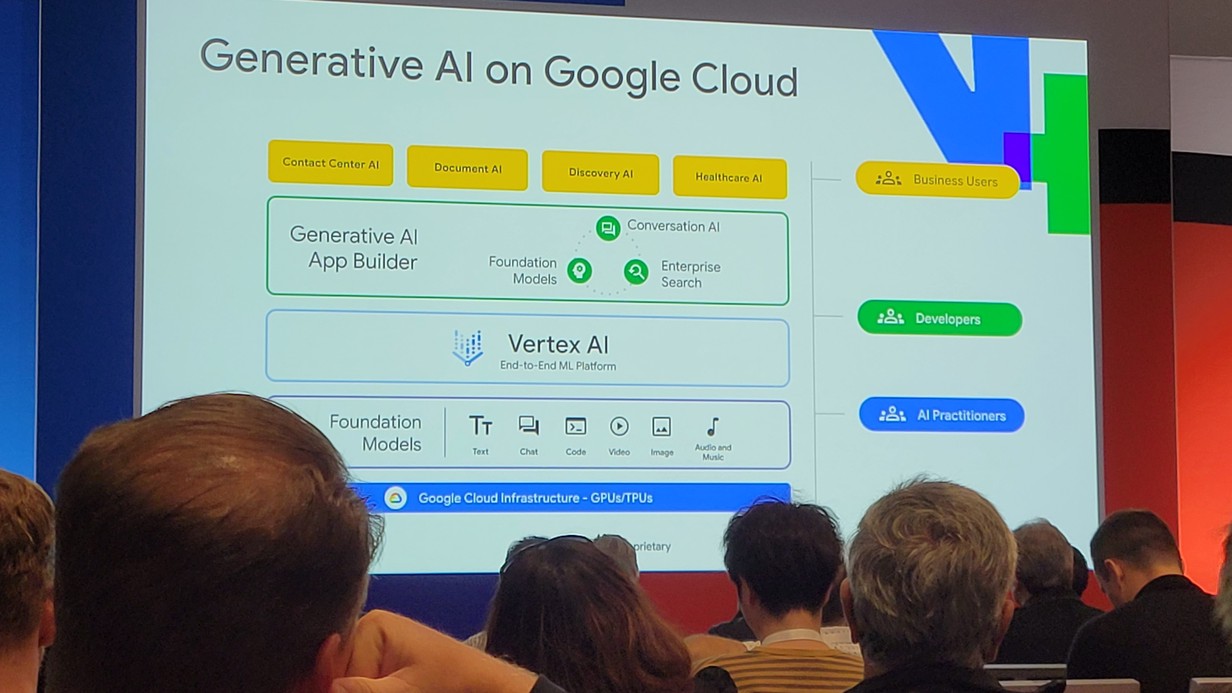

今回のCloud Nextでは、やはり生成AI(英語ではGenerative AI、あるいは単にGen AIと読んだりする)についての製品/ソリューションのアップデートがたくさん発表されました。生成AIについては、特に自然言語処理に関するところでは(よく知られている通り)OpenAIのChatGPTが性能/シェアいずれも他社を引き離しているという状況で、Googleはそれを追いかける立場となっています。Googleは、今年5月のGoogle I/Oにおいて、自然言語の生成AIソリューションとして、次のものをすでに発表していました。

- 自然言語の基盤モデル(PaLM 2)の発表。

- 機械学習を利用する統合環境であるVertex AIからのPaLM 2の利用

- 基盤モデルを使って既存のアプリケーションを拡張するDuet AIの発表

この発表から3ヶ月程度しか経っていませんが、今回のCloud Nextについては、これらそれぞれの機能改善・拡張の発表が中心に進みました。

キーノート

今回会場となった、モスコーニ・センター(Moscone Center) は、サンフランシスコ中心部ダウンタウンにある大規模なカンファレンスが開催できる会場です。

キーノート(Keynote)会場については、かなりの人数(2-3万人程度?)が収容できるスペースで実施されました。

初日最初のキーノートでは(事前に予告がなかったのですが)Google CEOのサンダー・ピチャイ氏(Sundar Pichai)が登場し、会場を沸かせました。これは事前に予告がなかったサプライズで、Googleの営業担当者の皆さんも知らなかったとのことであり、Google側の熱意の高さを感じました。

* なお、キーノートの動画は現在 Youtubeで公開されており、誰でも見ることができます

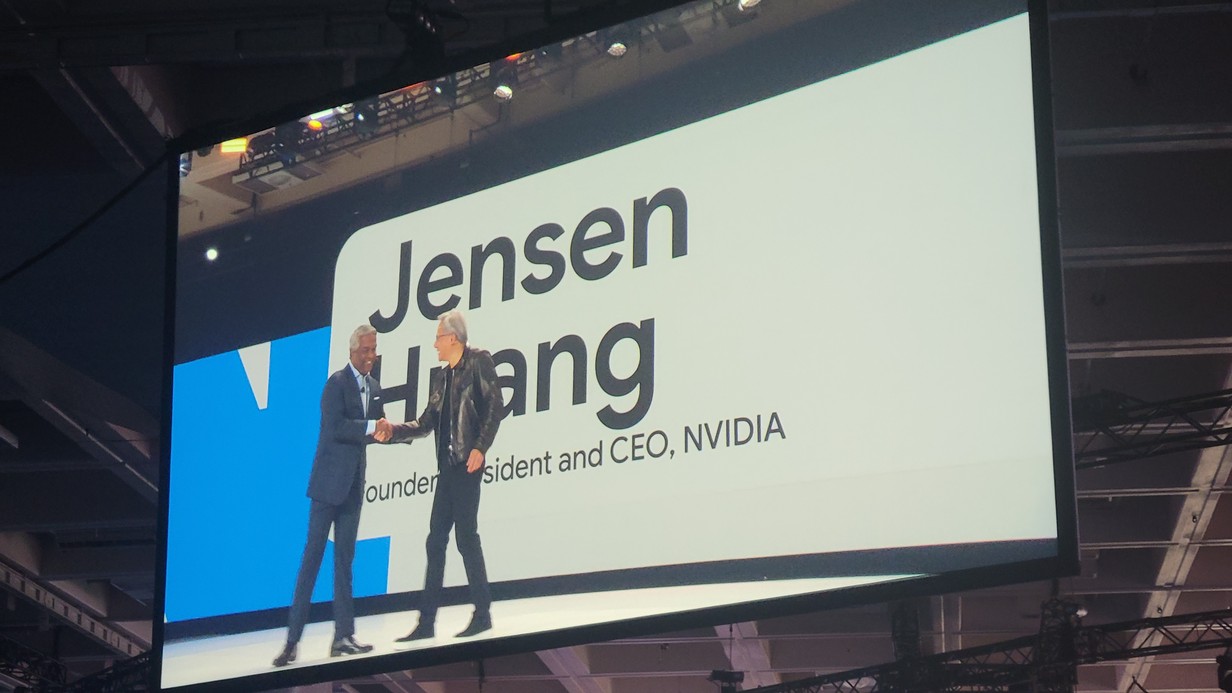

また、NVIDIAの新しいGPUであるH100を使ったインスタンスをGCPで提供するというところで、GoogleとNVIDIAの業務提携が発表され、その流れでNVIDIAのファンCEOが登場し、非常に豪華な印象を受けました。

キーノートは、ピチャイ氏が概要を説明し、Google CloudのCEO (Thomas Kurian) が詳細を説明するという流れで実施されました。やはり内容は生成AIに関連するものが多くを占め、PaLM 2 / Vertex AI / Duet AIに関する内容を中心に説明があり、やはりこの分野におけるOpenAIに対するフォロワーとしての立場を挽回しようとするGoogleの気合いを強く感じました。

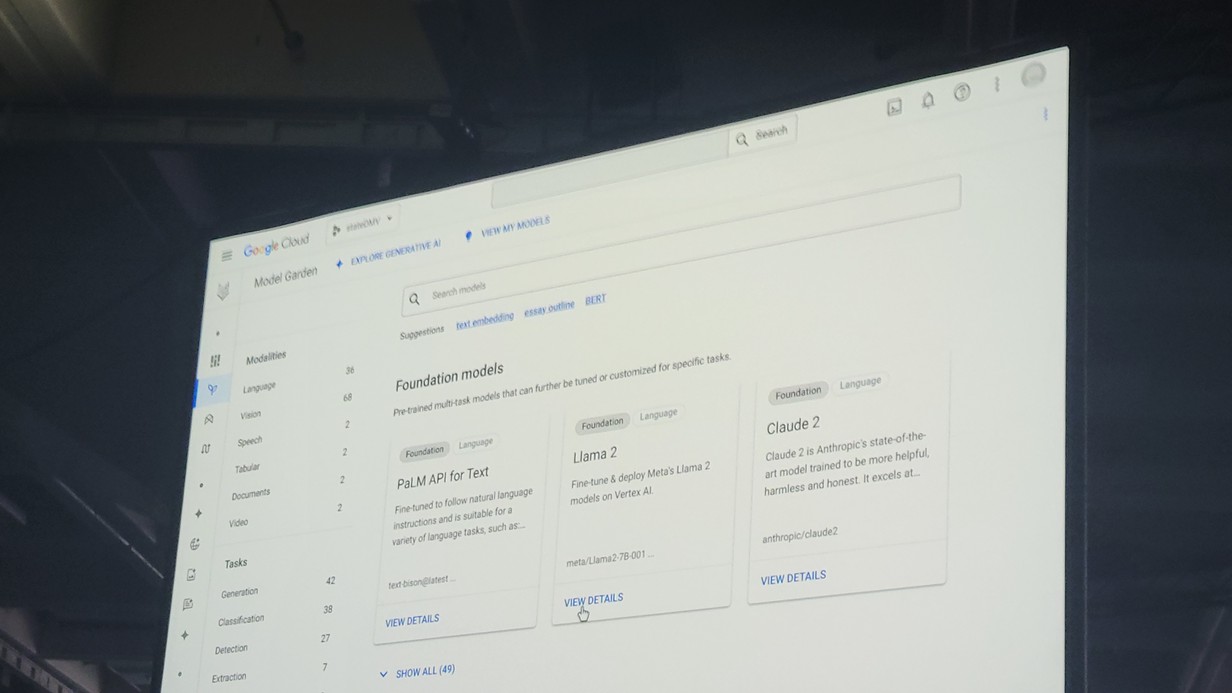

非常に驚いたのは、このキーノートの内容に、生成AIで使える基盤モデルとしてMeta(= Facebookの運営母体) が開発したLlama 2と呼ばれるモデルを使うことができ、かつ数日前に発表されたばかりのCode Llamaについても連携できる、と発表していた点です。Metaについては、生成AIの競合として位置付けられると一般的には考えられていると思っていたのですが、Llama 2のライセンスが営利利用を許可する点から、Googleでも柔軟に利用していこうと判断したようであり、この辺りの柔軟な判断については非常に興味深いものであり、今後も注視が必要なところかなと思いました。

セッション

キーノートの後は、2日半に渡って、45分のセッションが複数のカンファレンスルームで同時進行で進みました。合計で100近いセッションがあったのでしょうか。すべてを網羅することは非常に難しいため、それぞれ参加者はアプリに自分が出席したいセッションを登録し、その時間割に沿ってカンファレンスルームを移動してセッションに参加する形態となりました。

私は、AI/MLのトレンドをキャッチアップするというのをテーマとしていたので、AI系のセッションを中心に時間割を組んで参加しました。大まかには、次のセッションの話を聞きました。

- 生成AIの基盤モデルについて

- 生成AIを使ったアプリケーション・ライブラリ群の拡張

以下、いくつか興味深かかった内容をダイジェストで挙げます。

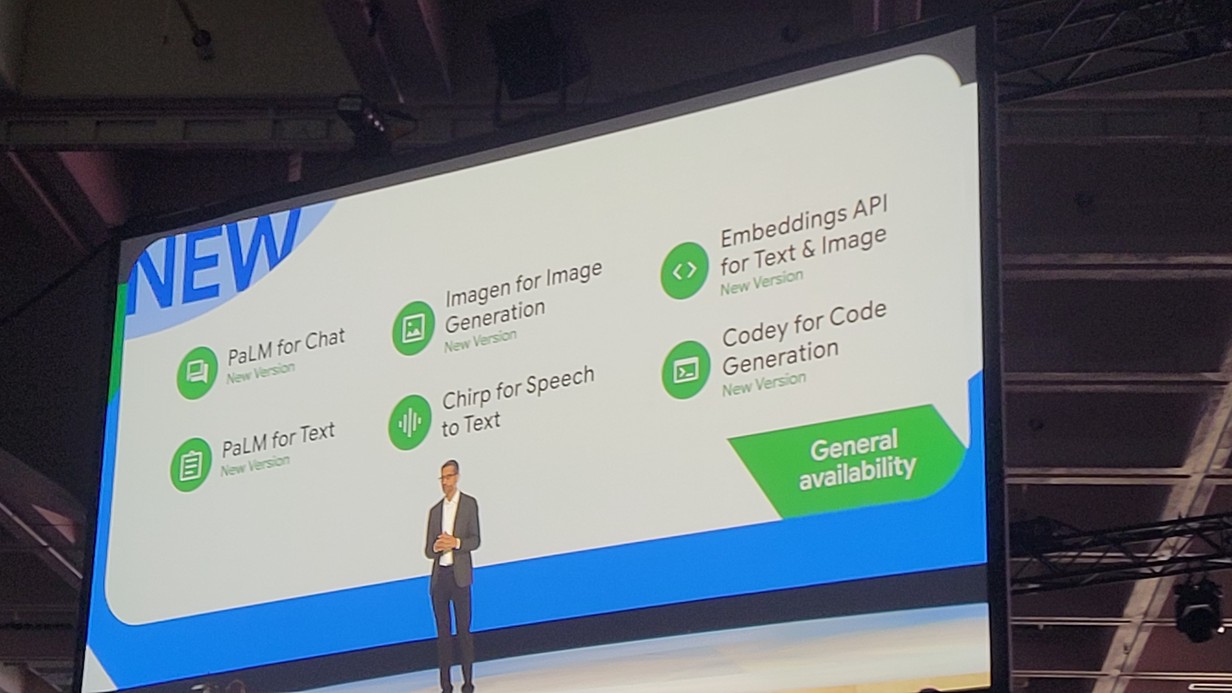

実は私は、すでにGoogle I/Oなどで発表された内容を再度説明するだけなのかなと思って(つまり本質的に新しい発表は何もないんだろうなと思って)出席したのですが、今回のGoogle Cloud Nextでは新しくリリースされた機能が膨大で、正直、大変に驚きました。

* なお、詳細な内容は以下の記事がわかりやすくまとまっています。

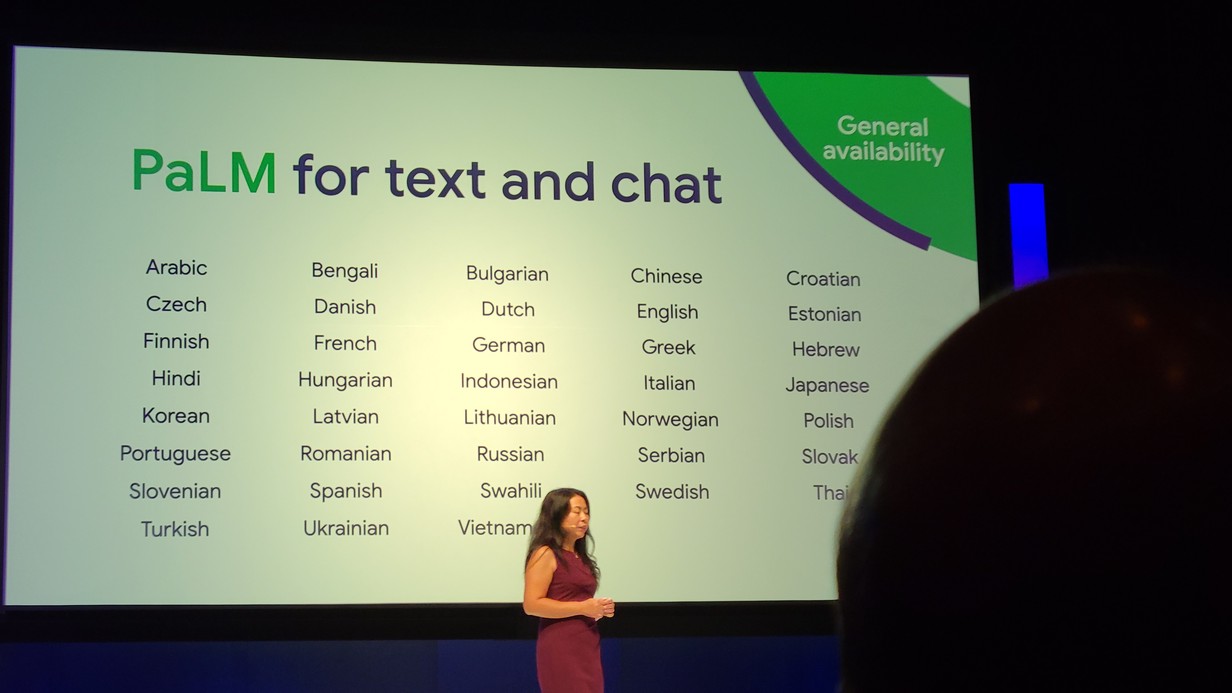

自然言語の生成AIであるPaLM 2については、発表時点で日本語に対応していませんでしたが、日本語に対応する(GA)ということが発表になりました(ただしこれは前週日本で実施されたイベントで先行してアナウンスがありました)

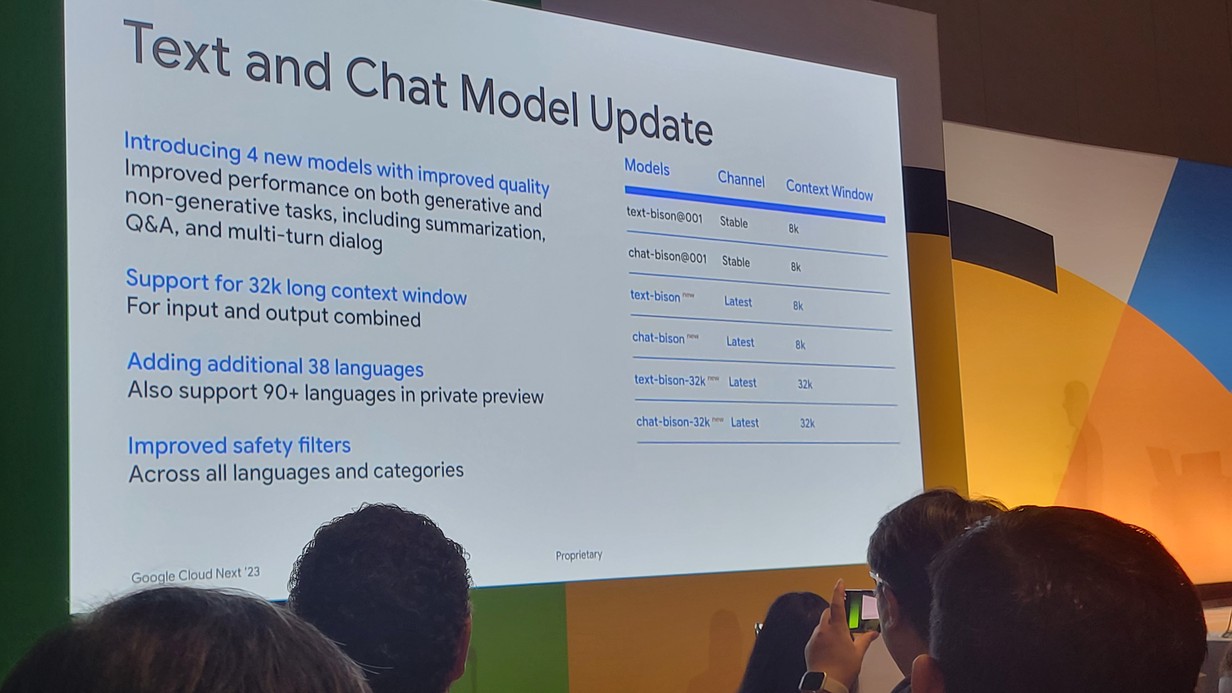

また、入力トークンとして、32kという比較的長い文字列の入力に対応したモデルが公開された旨も同時に発表になっています。学習データも比較的直近のデータに合わせて、精度もやや向上したという発表がありました。機能面でさまざまな優劣はありますが、いくつかの点でOpenAIと比肩しうる性能をもってきたと言えるかもしれません。ただ、これらが実際の商用環境において使えるほどの精度を持ち得るか(特に他の言語モデルと比較した場合の精度)については、今年7月にプレスリリースも出したビズリーチのレジュメ自動作成機能や、長い文章要約など我々のサービスにおいて有用と考えられる局面において適用した場合にどの程度の性能を持ち得るか、しっかり比較していきたいと思います。

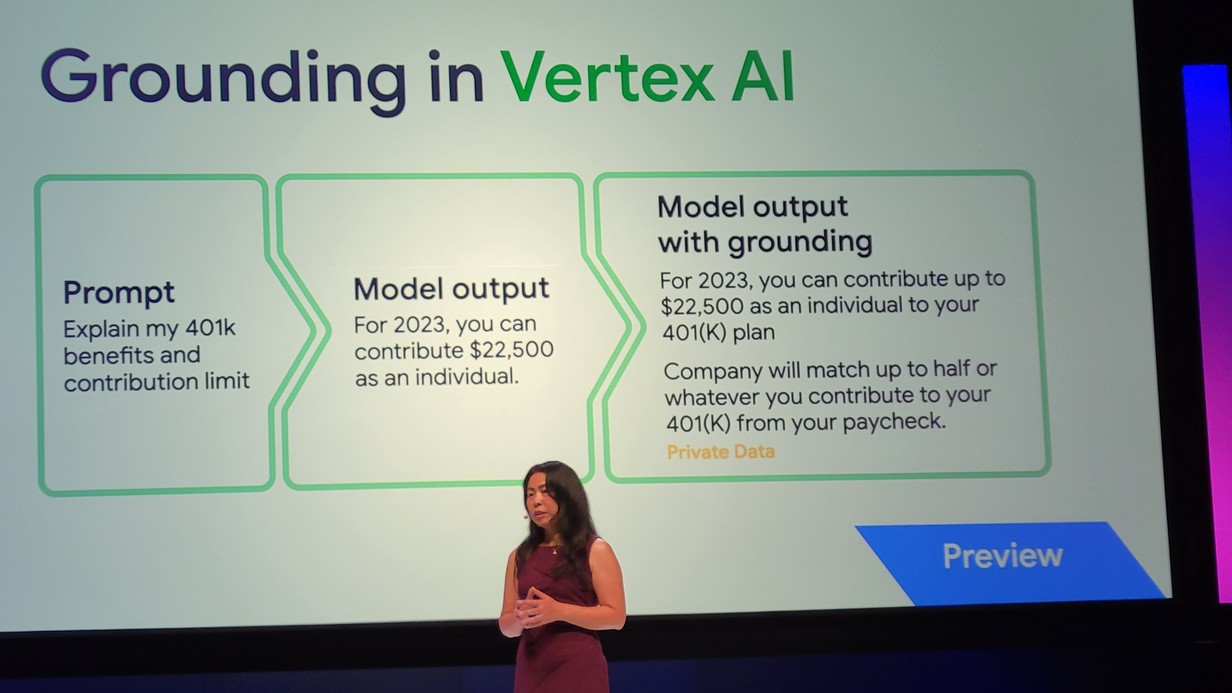

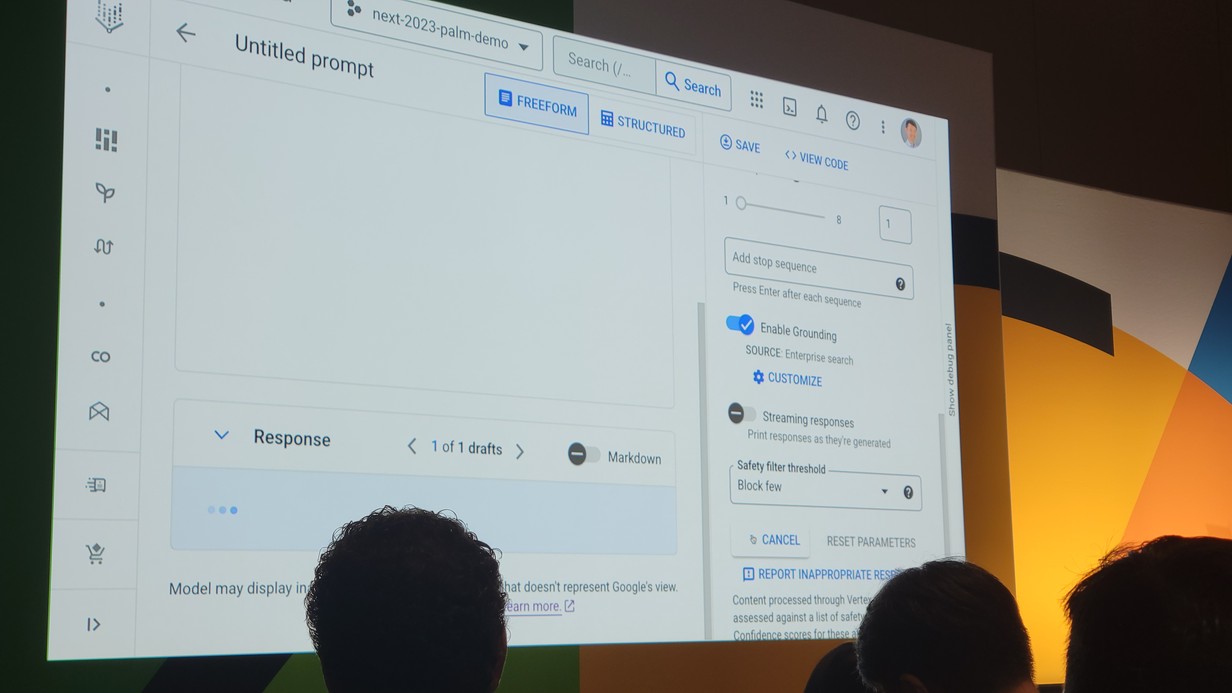

Vertex AIについても重要な発表が複数ありましたが、なかでも「事実に基づく生成」という意味である「グラウンディング」(Grouding)に対応したという点が非常に目を引く点であると考えます。従来、生成AIでは「学習時点において入力した事実についてしか生成することができない」という欠点がありましたが、今回対応したグラウンディングにより、入力したテキストの内容に基づいて応答を変えることが可能となります。

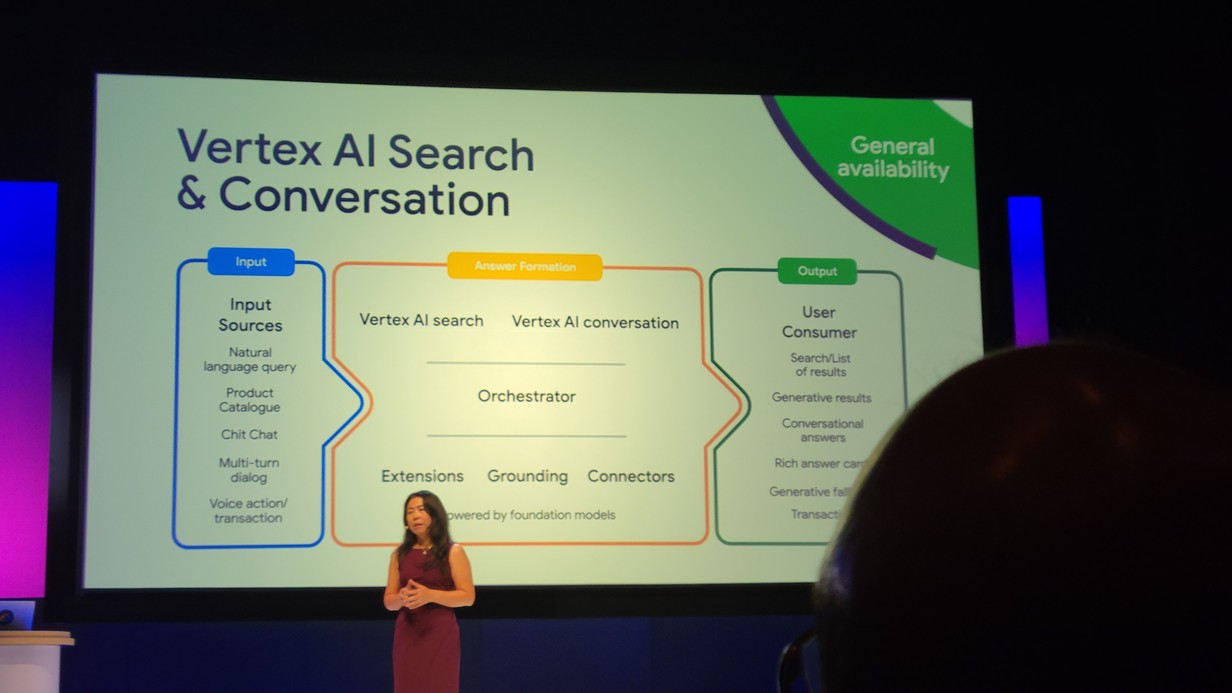

またこれらのグラウンディングに関連して、用意したドキュメントに基づいて問い合わせに対する検索結果を返す機能と、チャットで問い合わせに対応する機能の実装を用意する仕組み (Vertex AI Search / Conversation) の提供も発表されました。

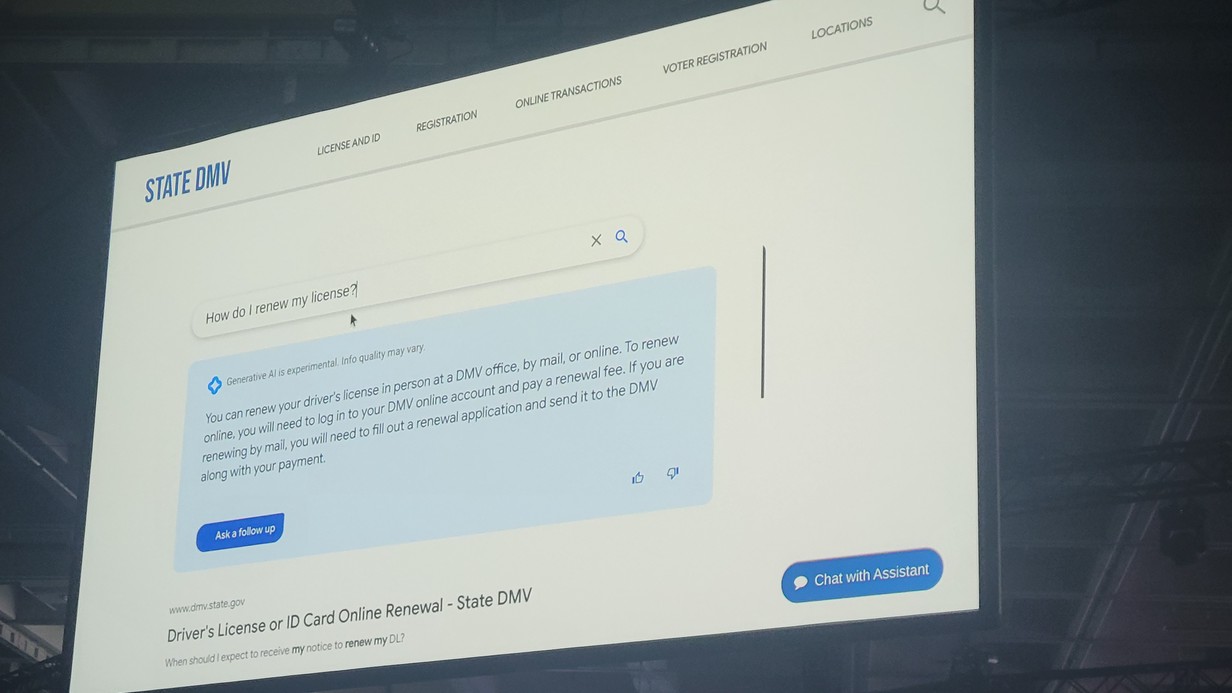

この点はキーノートでも触れられており、サンプル例として顧客向けサービスにおける問い合わせ対応UIとして、会社で保持するデータセットに基づいて回答し、対応するドキュメントへのリンクを示す例が示されました。

実はこの「グラウンディング」については、すでにOpenAIと、いくつかのライブラリを組み合わせることで実現できることが知られており、またAzureでは “Azure OpenAI on your data” という名前でソリューションを提供しているため、実はVertex AIで初めて世の中で利用できるようになったわけではありませんが、用意されている関数やUIの操作によるだけで簡易に利用できるようになった点は大きいと考えられます。実際に、Vertex AIに “Enable grounding” というスイッチがあり、これをOnにして設定事項を入力するだけで対応できるUIとなっており、わかりやすいなという印象を持ちました。

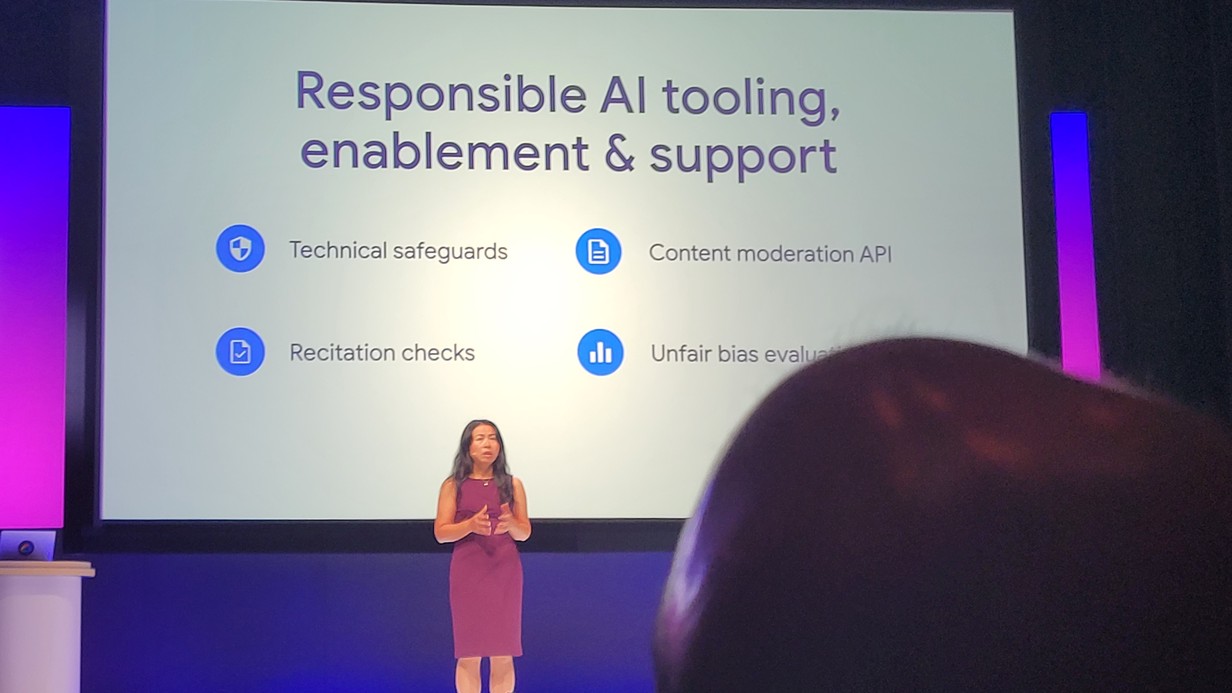

その他、「責任のあるAI」(Responsible AI) という名前で、生成AIモデルへの入力/出力に対して問題のある内容を判定したり除外したりする機能を備えたり、画像であれば、電子透かし(watermarking)を入れて、生成した画像の流通をトラッキングできるという側面を強調したりしていました。

生成AIを使った具体的なサービス

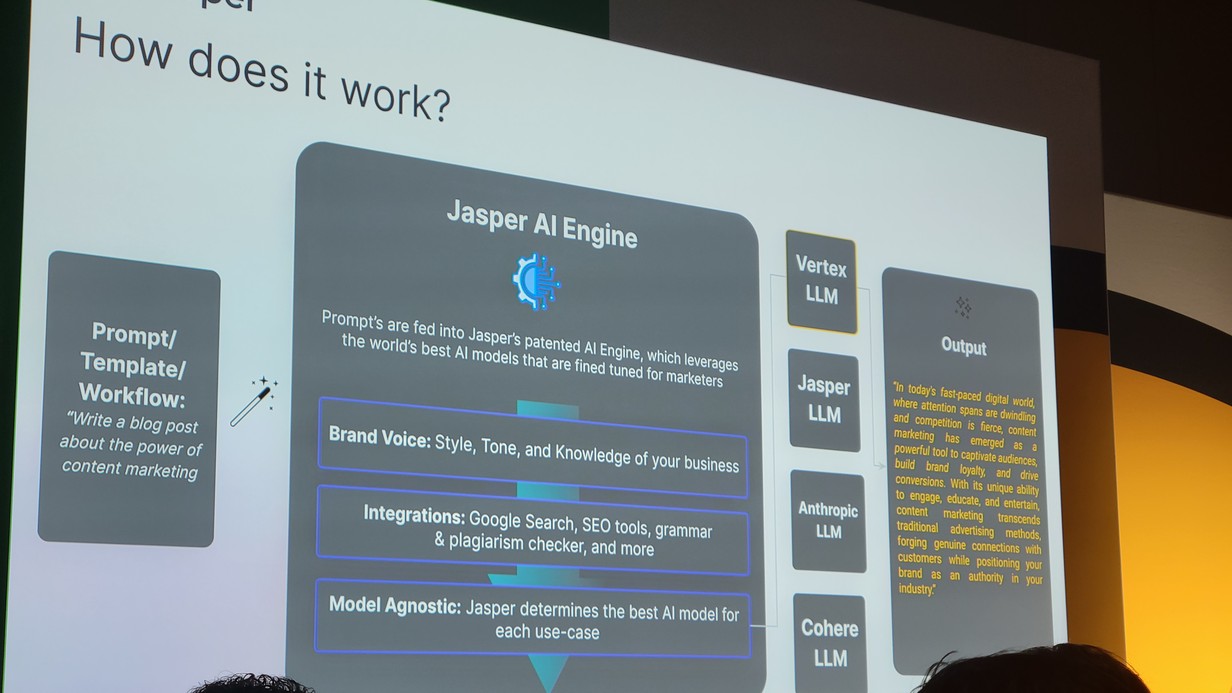

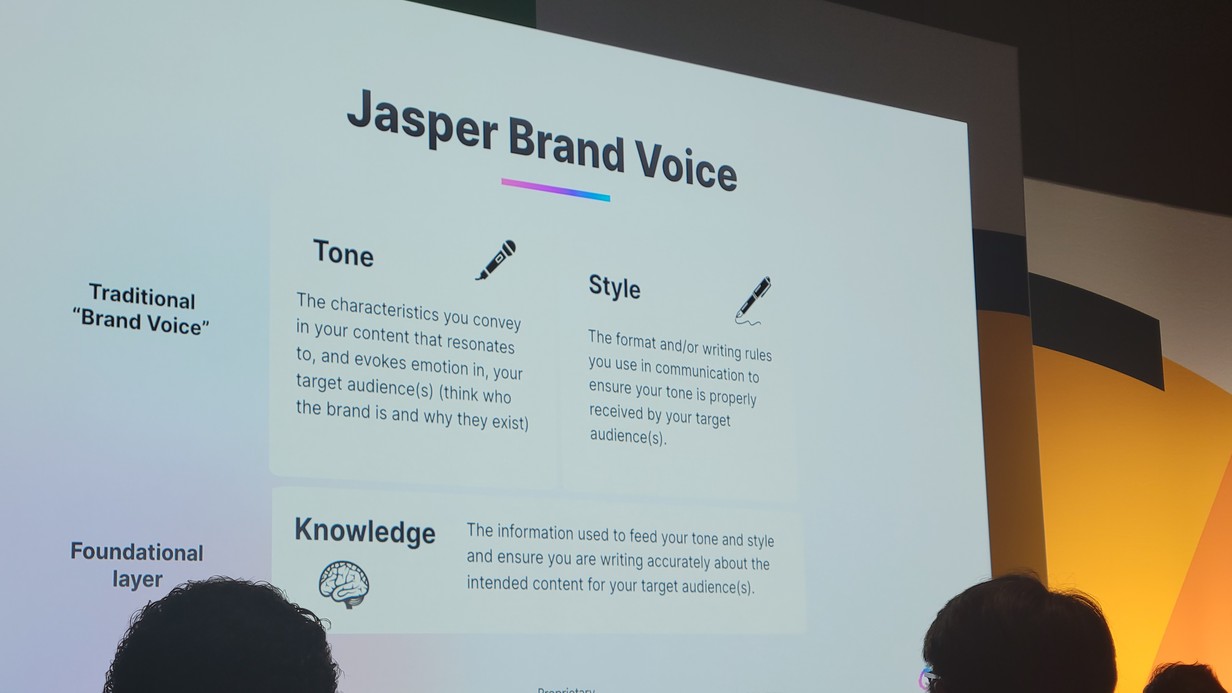

今回は生成AIを使った具体的なサービスを各社が紹介するセッションもたくさんありました。その中で、自分が特に面白いなと思ったのは、“Jasper” というマーケティングのサービスについてでした。“Jasper” は、販売していきたい製品/サービスについて、基本コンセプトを書いておくと、それに関連して、ブログ記事や各種広告の最適なテキスト/クリエイティブを自動生成したり、簡単な操作でスタイルを変更できるというものであり、ここに生成AIのロジックを使っているという話でした。

またこの他にも広告画像について、パーソナライズした画像を生成するソリューションを紹介する会社もありました。こういう生成を生かしたマーケティング系のサービスは、かなり拡大して行くのかなという印象です。

総合的な印象

今回のカンファレンスについては、アップデートが非常にたくさんあり、網羅的に書くと膨大な内容になってしまう量になります。正直なところ、セッションでもキャッチアップするのが大変であり、この点は全く予期していなかったところでした。

そんな中で、総じて2つの印象を持ちました。

1つ目として、生成AIという比較的最近出てきた技術について、Googleもユーザ企業もエンジニアも、短時間でフォローをしていることに驚きを感じたという点です。自然言語系でいけばOpenAIのGPT-4の発表からわずか5ヶ月であり、生成系モデルのFine-Tuningについては、AdapterやRLHFなどここ1年でホットトピックスになった技術も多数ありますが、セッションでこれらの話題について熱く議論が交わされるなど、技術進展に必死で追いつこうとしている熱意を感じました。

2つ目として、生成AIの技術が新しく出た一方で、革新的に新しいアプリケーションがあるかというと、そうでもないのかなという印象を受けました。生成AIという「基盤技術」が進展する一方で、これをビジネスにどう生かして行くのか、という点についてはまだまだ開拓の余地があるところであり、どの会社においてもエンジニアがビジネスサイドの課題を理解し、それをどう使って行くのかということを実験していくということが今後必要になるのかなと思いました。

Google LLC本社訪問

カンファレンスが終了した翌日の9/1に、サンフランシスコ中心部から離れたマウンテンビュー(Mountain View)にあるGoogle本社を訪問し、新しくできた社屋を見学しました。ここはコロナが発生した後、オフィスへ社員を回帰させることを意図して建造された建物で、非常に広々としていました。社屋内に大きな食堂があって、ここで食事ができる他、一定の間隔で用意された軽食スペースなど、快適な職場空間だなと思いました。ここはGoogleの力を見せつけられた感がありました。

サンフランシスコ

カンファンレンス以外に、サンフランシスコを訪問地として見た場合の印象を書いておきます。

サンフランシスコは、最高気温が20-25度程度で、昼間を除いて長袖の服を着ていて快適な感じでした。同時期の東京が36度近い気温であったことを考えると、とてもありがたいところでした。ただし、郊外にはやや治安の悪い区画もあり、良いところばかりではないという印象もあったのも事実です。また、事前に想定していた通り、物価が非常に高く、簡単に食べられるような昼食でも2,000円程度最低でもかかることを覚悟しなくてはいけませんでした。

また、他の海外と同様ではありますが、移動はほぼUberを使って移動できます。これは非常に便利で、どこにいてもUberでタクシーをアレンジすれば、ほぼどこにいても、どこへも移動が簡単です。ちなみに、Uberの本社もサンフランシスコにあります。また、サンフランシスコ市内では試験的な運用のようですが、無人運転によるタクシーも街で見かけることもしばしばあり、こうやって社会に影響を与えるサービスをどんどん作っているシリコンバレーの威力には驚かされる毎日でした。

まとめ

今回のカンファレンスでは、Googleのプロダクトの最新機能アナウンスが中心でしたが、今なお衰えない生成AIの進展の勢いを、本場シリコンバレーで感じる非常に良い機会となったと感じています。Googleのプロダクトに限らず、クラウドサービスが提供するもの、フリーで提供されているLLMモデルなど、発展が著しい中でも、ビズリーチの立場としては今後具体的にどのようにプロダクトに適用していくかが大きな鍵であり、今回のカンファレンスでの知見を活かしていければと考えています。